Beiträge: 4.078

Themen: 19

Registriert seit: 10.12.2012

(05.02.2026, 20:16)capslock schrieb: Dahinter steckt meine vielleicht naive Vorstellung, dass der jeweilig zuständige Bereich der Hörschnecke immer die gleiche Anzahl von Perioden braucht, bis er anspricht.

Es hilft, sich die Hörschnecke wie einen Messempfänger vorzustellen: ein frei durchstimmbarer Bandpassfilter. Dabei ist die "Empfängerbandbreite" (RBW, hier spricht der EMVler  ) nicht gleichmäßig und mit dem Pegel nicht-linear. In der Psychoakustik nutzt man den Begriff "Equivalent Rectangular Bandwidth (ERB)". Dann ist die Sache mit den Perioden zumindest ganz gut vorstellbar.

Die weitere Auswertung, wie die Tonhöhenerkennung, findet später statt, das ist dann afaik eine neurologische Sache.

Beiträge: 1.536

Themen: 44

Registriert seit: 18.03.2009

(05.02.2026, 20:28)Darakon schrieb: Ich habe noch mal mal ein wenig simuliert. Danke für die gut gemachte Simu!

Für mich ziehe ich 2 Sachen raus (auch, nachdem ich schon bei der Chlang3 anno 2014 mit "schönen" Sprungantworten experimentiert hatte):

- wenn sich das Abstrahlverhalten ändert, kann man's hören

- wenn die Phasenlage im Übernahmebereich der Chassis passt, hat man das Wesentliche schon erreicht

Und insgesamt Danke für die interessante Diskussion hier! Ich lese gerne mit.

Grüße

Chlang

[SIZE=2]Alle selbst ernannten Götter werden dir zürnen, wenn du dich nicht von ihnen erlösen lässt.

[/SIZE]:dont_know:

Beiträge: 4.078

Themen: 19

Registriert seit: 10.12.2012

(05.02.2026, 20:28)Darakon schrieb: 1) IIR-Filter ohne Zeitkorrektur zwischen HT und MT.

2) Selbe wie 1) aber mit Zeitkorrektur, um ein gleichmäßiges hor. Abstrahlverhalten zu erreichen

Und während du das tust, wird der Achsfrequenzgang ganz anders. Wenn du dir noch die Mühe machen willst dann pass den Filter 1) so an, dass die Summe genauso aussieht wie in 2). Und zwar nicht ein Über-alles-EQ, sondern die Filterflanken an sich anpacken.

Im dem Zuge werden die Klangunterschiede von "erheblich" in Richtung "kaum noch wahrnehmbar" gehen.

Das ein Zeitkorrektur den Prozess vereinfachen kann ist klar, allerdings ist das in der Praxis nicht mehr so einfach umsetzbar, da kommt dann auch viel händisches Ausprobieren zum Einsatz.

Beiträge: 1.780

Themen: 100

Registriert seit: 25.09.2013

(06.02.2026, 07:39)Chlang schrieb: (05.02.2026, 20:28)Darakon schrieb: Ich habe noch mal mal ein wenig simuliert. Danke für die gut gemachte Simu!

Für mich ziehe ich 2 Sachen raus (auch, nachdem ich schon bei der Chlang3 anno 2014 mit "schönen" Sprungantworten experimentiert hatte):

- wenn sich das Abstrahlverhalten ändert, kann man's hören

- wenn die Phasenlage im Übernahmebereich der Chassis passt, hat man das Wesentliche schon erreicht

Und insgesamt Danke für die interessante Diskussion hier! Ich lese gerne mit.

Grüße

Chlang

Danke. Freut mich, wenn es irgendwie hilfreich ist. Mir hilft es jedenfalls immer fürs eigene Verständnis solche Sachverhalten über eine Simulation in VituixCAD nachzuvollziehen. Zumal man die Ergebnisse schön visuell in Echtzeit dargestellt bekommt.

Heißt aber nicht, dass das was ich hier zeige die absolute Wahrheit ist. Ist auch nur selbst beigebracht. Und das "Wissen" steckt in der Simulation. Ich kann nur hoffen, dass ich die Simulation richtig bediene.

Falls jemand die Möglichkeiten hat:

Wäre interessant die theoretischen Ergebnisse hinsichtlich Delay und IIR/FIR mal mit Messungen (und einem DSP) zu validieren.

Beiträge: 2.358

Themen: 135

Registriert seit: 18.07.2012

06.02.2026, 09:13

(Dieser Beitrag wurde zuletzt bearbeitet: 06.02.2026, 09:15 von capslock.)

(06.02.2026, 07:19)JFA schrieb: (05.02.2026, 20:16)capslock schrieb: Dahinter steckt meine vielleicht naive Vorstellung, dass der jeweilig zuständige Bereich der Hörschnecke immer die gleiche Anzahl von Perioden braucht, bis er anspricht.

Es hilft, sich die Hörschnecke wie einen Messempfänger vorzustellen: ein frei durchstimmbarer Bandpassfilter. Dabei ist die "Empfängerbandbreite" (RBW, hier spricht der EMVler  ) nicht gleichmäßig und mit dem Pegel nicht-linear. In der Psychoakustik nutzt man den Begriff "Equivalent Rectangular Bandwidth (ERB)". Dann ist die Sache mit den Perioden zumindest ganz gut vorstellbar. ) nicht gleichmäßig und mit dem Pegel nicht-linear. In der Psychoakustik nutzt man den Begriff "Equivalent Rectangular Bandwidth (ERB)". Dann ist die Sache mit den Perioden zumindest ganz gut vorstellbar.

Die weitere Auswertung, wie die Tonhöhenerkennung, findet später statt, das ist dann afaik eine neurologische Sache.

Was ist dann Dein Fazit? Unterhalb 1 kHz immer längere tolerable Zeiten, weil es proportional zur Periodendauer geht? Also in Perioden ausgedrückt konstante tolerable Perioden an Verzögerung?

Wieso frei durchstimmbar? Es ist doch eher so, dass verschiedene Orte eine unterschiedliche Resonanzfrequenz haben, also eher eine Ansammlung von unterschiedlichen Filtern.

Auch eine Ansammlung von Bandpassfiltern sollte doch LTI sein, woher dann die Pegelabhängigkeit?

Beiträge: 728

Themen: 3

Registriert seit: 20.02.2018

06.02.2026, 09:34

(Dieser Beitrag wurde zuletzt bearbeitet: 06.02.2026, 10:33 von walwal.)

@ Darakon

Die Impulsantworten interessieren mich.

Ein paar Gedanken zum Themamit Bitte um Korrektur, wenn ich falsch denke:

Wenn ein Chassis vorauseilt, hat das einfluss auf die Phasenbeziehung. Man kann das Chassis geometrisch zurücksetzen, aber dann wirkt die Korrektur nur auf Achse, unter horizontalen Winkeln immer weniger, bei 90 Grad ohne Wirkung. Das ist ein weiterer Nachteil.

Korrigiert man das durch ein elektrisches Delay (zB IIR) wirkt das unter allen horizontalen Winkeln (bei Coax unter allen Winkeln).

Aber es ist nicht zeitrichtig, nur phasenrichtig.

https://forum.visaton.de/forum/messtechn...post730389

https://forum.visaton.de/forum/messtechn...post730394

Mit FIR wird es auch zeitrichtig. Ob das besser klingt, soll hier nicht beantwortet werden.

Die Bündelung/Abstrahlung ändert sich durch FIR im Vergleich zu IIR nicht.

Das gab es schon mal:

https://www.diy-hifi-forum.eu/showthread.php?tid=18684

Beiträge: 1.536

Themen: 44

Registriert seit: 18.03.2009

(06.02.2026, 09:34)walwal schrieb: Korrigiert man das durch ein elektrisches Delay (zB IIR) wirkt das unter allen horizontalen Winkeln (bei Coax unter allen Winkeln). Leider nein: Wenn das Problem geometrisch bedingt ist ("Schallentstehungsort liegt unterschiedlich tief in der Schallwand") kann man sich gut vorstellen, dass die Zeitkorrektur zwar auf Achse funktioniert (Hochtöner wird verzögert, weil "Schallentstehungsort" näher am Empfänger liegt), unter Winkeln aber wieder ein Problem hat (unter 90° liegen die "Schallentstehungsorte" dann auf einer Ebene in Bezug auf den Empfänger und der Hochtöner kommt jetzt "zu spät").

Grüße

Chlang

[SIZE=2]Alle selbst ernannten Götter werden dir zürnen, wenn du dich nicht von ihnen erlösen lässt.

[/SIZE]:dont_know:

Beiträge: 728

Themen: 3

Registriert seit: 20.02.2018

Danke für die Richtigstellung.

Beiträge: 4.078

Themen: 19

Registriert seit: 10.12.2012

(06.02.2026, 09:13)capslock schrieb: Was ist dann Dein Fazit? Unterhalb 1 kHz immer längere tolerable Zeiten, weil es proportional zur Periodendauer geht? Also in Perioden ausgedrückt konstante tolerable Perioden an Verzögerung?

Ja, wobei die Messdaten darauf hindeuten, dass das Verhältnis bei tiefen Frequenzen abflacht, also während es bei 1kHz noch 2 Perioden braucht sind es bei 500 Hz nur 1,8 oder so. Hängt eventuell mit der Kurve der ERB zusammen? Die hat ein ähnliches Verhalten (oben logarithmisch, unten linear).

Zitat:Wieso frei durchstimmbar? Es ist doch eher so, dass verschiedene Orte eine unterschiedliche Resonanzfrequenz haben, also eher eine Ansammlung von unterschiedlichen Filtern.

Jeder Ton erzeugt auf der Basilarmembran ein Resonanzmaximum an einer bestimmten Stelle. Das meine ich mit frei durchstimmbar. Das passt auch zur Maskierung: ein Ton (schmalbandiges Rauschen) erzeugt eine Maskierung nach oben und unten, weil er eben auch andere Bereichen anregt (die daneben).

Interessant sind dann noch die Frequenzgruppen, die darauf hindeuten, dass da dann doch etwas mit "festen" Frequenzbereichen existiert*. Das ist, so viel ich weiß, aber auf neurologischer Ebene.

Zitat:Auch eine Ansammlung von Bandpassfiltern sollte doch LTI sein, woher dann die Pegelabhängigkeit?

Ich nehme an, dass da ja alles in allem erstmal in mechanisches System ist, daher die Nichtlinearität.

* Ich glaube sogar inzwischen, dass man bei der Messung den Frequenzgang über diese Bereiche mitteln sollte, und nicht stumpf mit relativer Bandbreite.

Beiträge: 1.780

Themen: 100

Registriert seit: 25.09.2013

06.02.2026, 11:45

(Dieser Beitrag wurde zuletzt bearbeitet: 06.02.2026, 20:27 von Darakon.)

(06.02.2026, 10:52)Chlang schrieb: (06.02.2026, 09:34)walwal schrieb: Korrigiert man das durch ein elektrisches Delay (zB IIR) wirkt das unter allen horizontalen Winkeln (bei Coax unter allen Winkeln). Leider nein: Wenn das Problem geometrisch bedingt ist ("Schallentstehungsort liegt unterschiedlich tief in der Schallwand") kann man sich gut vorstellen, dass die Zeitkorrektur zwar auf Achse funktioniert (Hochtöner wird verzögert, weil "Schallentstehungsort" näher am Empfänger liegt), unter Winkeln aber wieder ein Problem hat (unter 90° liegen die "Schallentstehungsorte" dann auf einer Ebene in Bezug auf den Empfänger und der Hochtöner kommt jetzt "zu spät").

Grüße

Chlang

Guter Punkt. Ich weiß nicht, ob ich das ausreichend genau in der Simulation betrachtet habe. Bzw ob VituixCAD da überhaupt einen Unterschied macht.

In VituixCAD kann man an zwei stellen einen Versatz bzw ein Delay einstellen:

1) Unter der Weiche bei den Parametern der einzelnen Treiber:

Versatz hochtöner.jpg

Versatz hochtöner.jpg (Größe: 3,94 KB / Downloads: 150)

2) Unter der Definition der einzelnen Treiber:

Delay.jpg

Delay.jpg (Größe: 2,86 KB / Downloads: 150)

Bei 1) würde ich von einem geometrischen Versatz ausgehen.

Bei 2) von einem Delay, das sich an einer DSP einstellen lässt. Das Delay wird wird automatisch in cm umgerechnet.

Das erste, was mit auffällt:

Ich würde eigentlich davon ausgehen, dass ich einen Versatz von -20mm unter 1) mit einem Versatz von +20mm unter 2) ausgleichen kann.

Dem ist allerding nicht so. Um -20mm unter 1) auszugleichen, muss ich unter 2) beim Delay auch -20mm eingeben (siehe Bilder)

Da scheint für mich die Richtung des Koordinatensystems nicht durchgängig. Habe ich einen Denkfehler oder sollte ich Kimmo auf den Fehler hinweisen?

_________________________________________________________________________________________________________________________________

Edit 06.02.: Mein Fehler! Hatte das Delay für HT und MT vertauscht => Kein Fehler in VituixCAD. Ist alles richtig, so wie es ist.

Die Aussage zum Verhalten unter Winkel sollte trotzdem stimmen.

_________________________________________________________________________________________________________________________________

Allerdings scheint Vituix CAD tatsächlich zwischen physischen Versatz und Delay zu unterscheiden.

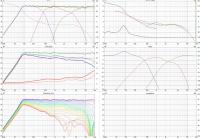

Hier einmal HT und MT in "Nulllage" (ohne Versatz) und ohne Delay mit linear-Phase Filtern:

Und hier zum Vergleich mit 20mm Versatz und diesen Versatz mittels Delay kompensiert (mit den Werten aus den Bildern weiter oben):

Wie von Chlang vorhergesagt zeigt sich unter Winkeln eine Abweichung.

Insgesamt ist der Energieverlauf und das Abstrahlverhalten bei der Variante ohne physischen Versatz gleichmäßiger.

Beiträge: 621

Themen: 60

Registriert seit: 16.05.2021

06.02.2026, 12:01

(Dieser Beitrag wurde zuletzt bearbeitet: 06.02.2026, 12:18 von TomBear.)

Hi zusammen.

Gibt es einen Anhaltspunkt bis welchen Versatz man ausgleichen kann ohne das es unter Winkeln zu größeren Problemen kommt?

Und noch zwei Fragen.

Es wird ja gesagt das man FIR nicht im Bassbereich nutzen sollte wegen den auftretenden Latenzen. Da ich gerne Konzertvideos schaue würde mich interessieren ab wo das kritisch wird.

Und macht das einen Unterschied ob ich ein Fertiggerät mit einer bestimmten Anzahl von Taps habe, oder einen guten PC mit 8 Kernen und 32 GB Ram?

Gruß Tommi

Beiträge: 1.780

Themen: 100

Registriert seit: 25.09.2013

06.02.2026, 12:18

(Dieser Beitrag wurde zuletzt bearbeitet: 06.02.2026, 12:22 von Darakon.)

Zitat von google-KI

"Die Latenz bei FIR-Filtern (Finite Impulse Response) hängt direkt von der Anzahl der Filterkoeffizienten (Taps) und der Abtastrate ab.

Sie beträgt typischerweise die Hälfte der Taps, was besonders bei linearphasigen Designs zu signifikanten Verzögerungen (oft >10-60 ms) führen kann.

Hohe Steilheit erfordert mehr Taps und erhöht die Latenz.

Wichtige Aspekte der FIR-Latenz:

Berechnung: Die Verzögerung in Abtastwerten ist oft \(\frac{N-1}{2}\), wobei \(N\) die Anzahl der Taps ist.

Bei 44,1 kHz können 3000 Taps über 60 ms Latenz bedeuten.Linearphasige Filter: Diese erzeugen eine konstante Gruppenlaufzeit über alle Frequenzen, verursachen aber eine feste Latenz, da der Impuls auf die Mitte der Taps zentriert wird.

Minimierung der Latenz: Durch Wahl von Minimalphasen-FIR-Filtern (statt linearphasig) kann die Latenz drastisch reduziert werden, da das Pre-Ringing entfällt.Einsatzgebiete: Während hohe Latenzen in der Studiotechnik oder bei PA-Systemen oft akzeptabel sind, erfordern Live-Anwendungen (Bühnenmonitoring) oft extrem kurze Latenzen (<3-5 ms)"

Meiner Erfahrungen nach sind Latenzen von 20ms bis 30 ms für Konzerte oder Filme noch akzeptabel (entspricht einer virtuellen Schall-Quellen-Entfernung von ca 8 Metern).

Das andere Problem ist das Pre-ringing, das bei linear Phase-Filtern auftritt (je tiefer und je steiler, desto mehr pre-ringing):

https://www.youtube.com/watch?v=vosxeF33upQ

Inwiefern minimum phase Filter Vorteile bringen gegenüber Linear Phase und wie man diese in eine DSP integriert, weiß ich nicht.

Ich meine mich an eine Diskussion hier zu erinnern, bei der rauskam, dass IIR Filter besser für Raum-Moden-Korrektur geeignet sind als FIR-Filter

Beiträge: 4.078

Themen: 19

Registriert seit: 10.12.2012

(06.02.2026, 12:01)TomBear schrieb: Es wird ja gesagt das man FIR nicht im Bassbereich nutzen sollte wegen den auftretenden Latenzen. Da ich gerne Konzertvideos schaue würde mich interessieren ab wo das kritisch wird.

https://www.itu.int/dms_pubrec/itu-r/rec...!PDF-E.pdf

Ganz am Anfang, Satz g): 45 ms Ton vor Bild und 125 ms Bild vor Ton sind Wahrnehmbarkeitsschwellen, bis 90 ms/180 ms ist es noch akzeptabel. Aber Vorsicht, da geht es um Lip Sync, das kann bei Musik anders sein (ich tippe da auf größere Schwellen).

Zitat:Und macht das einen Unterschied ob ich ein Fertiggerät mit einer bestimmten Anzahl von Taps habe, oder einen guten PC mit 8 Kernen und 32 GB Ram?

Wenn beide die gleiche Anzahl an Taps haben wird das "Fertiggerät", sofern es sich dabei um einen DSP handelt, immer gewinnen, weil er keine internen Puffer füllen muss.

Beiträge: 621

Themen: 60

Registriert seit: 16.05.2021

06.02.2026, 13:03

(Dieser Beitrag wurde zuletzt bearbeitet: 06.02.2026, 13:52 von TomBear.)

Hi Darakon.

Danke für die Antwort, nur leider bin ich bei mathematischen Berechnungen schon seit einigen Jahren raus. Muss ich wohl mal auffrischen.

Konkret höre ich Musik über Foobar mit 96/24, da ist die Latenz egal. Konzertvideos laufen über den VLC-Player. Ich frage mich nur ob man da FIR ab ca. 200Hz einsetzen kann.

Deiner Antwort entnehme ich schon mal das es keinen Unterschied zwischen Fertiggerät und PC wegen der Rechengeschwindigkeit gibt.

Gruß Tommi

P.s.: Will es mit REAPER und FIR-Filter versuchen, was Du vor ca. 3 Jahren mal hier im Forum empfohlen hast.

Danke für den Tipp.

Hi Jochen.

Soweit ich weiss ist bei der PC-Lösung die Anzahl der Taps um ein vielfaches höher.

Und da mehr Prozessorleistung und RAM wohl auch etwas ´´geschmeidiger´´.

Und danke für den Link. Gucke ich mir mal an . Aber 125ms Bild vor Ton hört sich nach einem guten Puffer an.

Gruß Tommi

Beiträge: 728

Themen: 3

Registriert seit: 20.02.2018

(06.02.2026, 12:18)Darakon schrieb: Zitat von google-KI

.....

Ich meine mich an eine Diskussion hier zu erinnern, bei der rauskam, dass IIR Filter besser für Raum-Moden-Korrektur geeignet sind als FIR-Filter

Ja, so habe ich das auch gelesen.

Latenzen kann doch der AVR ausgleichen mit Lip.Sync, oder reicht das nicht?

Beiträge: 4.078

Themen: 19

Registriert seit: 10.12.2012

(06.02.2026, 12:18)Darakon schrieb: Zitat von google-KI

"Die Latenz bei FIR-Filtern (Finite Impulse Response) hängt direkt von der Anzahl der Filterkoeffizienten (Taps) und der Abtastrate ab.

Sie beträgt typischerweise die Hälfte der Taps, was besonders bei linearphasigen Designs zu signifikanten Verzögerungen (oft >10-60 ms) führen kann.

Hohe Steilheit erfordert mehr Taps und erhöht die Latenz.

Nicht KI fragen, Jochen fragen. Sag ich auf der Arbeit auch immer.

Die intrinsische Latenz von FIR ist in Anzahl von Samplen

- bei direkter Berechnung: 0

- bei der Berechnung über die schnelle Faltung (iFFT(FFT(x)*FFT(filter)), naiv umgesetzt, gleich der FFT-Länge (die man sinnvollerweise auf die Anzahl der Taps setzt)

- bei der Berechnung über die schnelle Faltung, clever umgesetzt, gleich der verwendeten Blocklänge (FFT-Länge/Anzahl der Blocks)

Dazu kommt noch die Systemlatenz wenn wie bei PCs mit Puffern gearbeitet werden muss

Linearphasige Filter sind immer zeitsymmetrisch, und weil das sonst kausal schief geht (negative Zeit ist nicht) haben die also immer N/2 Latenz (Hinweis: Filter, die das Gesamtsystem phasenlinearisieren, müssen nicht symmetrisch sein und deswegen können die dann auch kürzere Latenzen haben; aber das Gesamtsystem, das ist dann wieder zeitsymmetrisch, also macht das am Ende des Tages nichts.

Zitat:Ich meine mich an eine Diskussion hier zu erinnern, bei der rauskam, dass IIR Filter besser für Raum-Moden-Korrektur geeignet sind als FIR-Filter

Der Aufwand für FIR ist halt bei tiefen Frequenz sehr hoch, also lässt man es besser bleiben, vor Allem weil es ja auch mit IIR gut geht.

Beiträge: 621

Themen: 60

Registriert seit: 16.05.2021

07.02.2026, 10:55

(Dieser Beitrag wurde zuletzt bearbeitet: 07.02.2026, 10:57 von TomBear.)

Was man schon hat und wieder vergisst. ![[Bild: smile.png]](https://diy-hifi-forum.eu/images/icons/smile.png)

Hatte ich mal gefunden und abgespeichert, aber nie gelesen:

https://www.static.tu.berlin/fileadmin/w...h_MasA.pdf

Ist eine Masterarbeit über einen Monitorlautsprecher mit DSP. FIR kommt da auch drin vor.

Einer der Gutachter ist Anselm Goertz, dürfte also interessant sein.

Viel Spass beim lesen, Tommi

P.s.: Wegen Lipp-Sync. Hab kein AVR.

Beiträge: 728

Themen: 3

Registriert seit: 20.02.2018

Zitat daraus:

Die Frage, ob sich die Linearisierung des Phasengangs durch eine FIR-Filterung

rentiert, kann nach der die Lautsprecherentwicklung und den Hörtests mit ei-

nem „Jein“ beantwortet werden. So zeigte zwar der AB-Hörversuch, dass es

Klangunterschiede gibt, allerdings wurden diese nur unter aufwendigen Be-

dingungen, wie schnellem Schalten der Stimuli und einer guten Raumakustik,

nachgewiesen. So beeinflusst ein Lautsprecher mit einer linearisierten Phase

durch FIR-Filterung das Ergebnis einer Musikproduktion nur kaum. Allerdings

sollte der Lautsprecher als letztes Glied der Audiosystemkette und Schnittstel-

le zwischen Mensch und Maschine so detailgetreu wie möglich arbeiten. Es ist

zu empfehlen den Vorteil der FIR-Phase in Betracht zu beziehen soweit hohe

Latenzen für bestimmte Anwendungsbereiche z.B. „Musik hören“ oder Maste-

ring akzeptabel sind

Beiträge: 69

Themen: 1

Registriert seit: 03.12.2025

Naja, der Unterschied kann dramatisch sein wenn der Lautsprecher dahingehend entwickelt wurde. FIR kann entscheidende Vorteile bringen, je tiefer es angewendet wird, unso schlechter ist das Ergebnis. Der Lag ist zB bei Stage Monitors oder generell live nicht akzeptabel. Wohlgemerkt bei tiefer frequenz, idR sind IIR Filter + Delay besser.

FIR Filter haben immer lag und haben IMMER pre-ring.

Beiträge: 32

Themen: 2

Registriert seit: 10.12.2025

(07.02.2026, 10:55)TomBear schrieb: Was man schon hat und wieder vergisst.![[Bild: smile.png]](https://diy-hifi-forum.eu/images/icons/smile.png)

Hatte ich mal gefunden und abgespeichert, aber nie gelesen:

https://www.static.tu.berlin/fileadmin/w...h_MasA.pdf

Ist eine Masterarbeit über einen Monitorlautsprecher mit DSP. FIR kommt da auch drin vor.

Einer der Gutachter ist Anselm Goertz, dürfte also interessant sein.

Viel Spass beim lesen, Tommi

P.s.: Wegen Lipp-Sync. Hab kein AVR.

Danke für den Link

Lehrreicher Stoff

Grüße Thomas

|

) nicht gleichmäßig und mit dem Pegel nicht-linear. In der Psychoakustik nutzt man den Begriff "Equivalent Rectangular Bandwidth (ERB)". Dann ist die Sache mit den Perioden zumindest ganz gut vorstellbar.

) nicht gleichmäßig und mit dem Pegel nicht-linear. In der Psychoakustik nutzt man den Begriff "Equivalent Rectangular Bandwidth (ERB)". Dann ist die Sache mit den Perioden zumindest ganz gut vorstellbar.